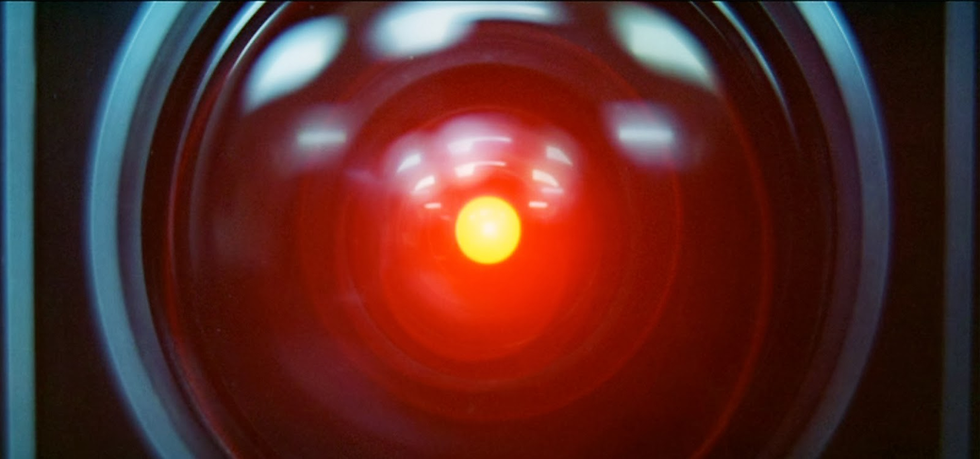

"Desculpe, Dave. Receio que não possa fazer isso": um olhar sobre os desafios e os limites da autonomia das IAs

- Lara Chaves

- 6 de jan. de 2025

- 3 min de leitura

Quando Arthur C. Clarke e Stanley Kubrick deram vida a HAL 9000, o cenário descrito em 2001: Uma Odisseia no Espaço parecia distante e quase utópico. A ideia de uma inteligência artificial capaz de pilotar uma nave espacial parecia mais um produto da ficção científica do que uma possibilidade real. HAL é a sigla para "Heuristically programmed ALgorithmic computer" (computador algorítmico programado heuristicamente, em tradução livre).

Os algoritmos heurísticos, que se baseiam em intuição ou construção empírica, oferecem soluções viáveis para problemas de otimização combinatória a um custo aceitável em termos de tempo e recursos computacionais (Goli et al., 2021 apud. Zhao et al., 2024) e são fundamentais na otimização do treinamento de redes neurais - funções matemáticas biologicamente inspiradas, formadas por neurônios artificiais que interagem entre si (Kaufman e Santaella, 2020). A utilização dos algoritmos metaheurísticos melhoram o desempenho e a eficiência do aprendizado dessas redes, que imitam a estrutura e a função do cérebro humano (Osaba et al., 2021 apud. Zhao et al., 2024).

Muitos pesquisadores descrevem as redes neurais como caixas pretas, expressão comumente usada em referência à ideia de estabilidade dos algoritmos (Jurno e Dalben, 2018). No entanto, essa estabilidade é ilusória, já que os algoritmos podem ser alterados de forma fácil, instantânea, radical e invisível. Mesmo que grandes atualizações ocorram ocasionalmente, esses sistemas passam por constantes “ajustes”, (Gillespie, 2014 apud Jurno e Dalben, 2018) que moldam seu comportamento de acordo com os objetivos definidos. Para que as redes neurais funcionem adequadamente, é necessário que elas aprendam a aplicar regras em diferentes ambientes, o que exige grandes volumes de dados rotulados por humanos para aprimorar sua precisão (Zhao et al., 2024). Assim, a manipulação dos dados utilizados no treinamento não apenas influencia o desempenho das redes, mas também reflete interesses específicos relacionados ao uso estratégico dessas informações.

Nesse contexto, a coleta massiva de dados não é apenas um aspecto técnico, mas também um componente central do capitalismo de vigilância, que se manifesta na forma de controle social e exploração econômica. A vulnerabilidade dessa dinâmica é visível em casos como o Cambridge Analytica, que, em 2018, revelou que obteve, sem consentimento, dados pessoais de cerca de 87 milhões de usuários do Facebook, coletados entre 2013 e 2015. Esses dados foram utilizados para criar perfis psicológicos detalhados, permitindo a segmentação de anúncios políticos durante as eleições de 2016 nos Estados Unidos e no referendo do Brexit. A exposição desse escândalo não apenas levantou questões éticas sobre privacidade e manipulação, mas também resultou em uma significativa diminuição do valor de mercado do Facebook, que perdeu bilhões de dólares em capitalização.

A lógica desse sistema inclui até mesmo os contextos mais críticos e vulneráveis, como a coleta de dados de guerra para treinar modelos de inteligência artificial. O avanço tecnológico em inteligência militar inaugurou uma nova fronteira na exploração de dados, transformando cada registro em vantagem estratégica e reforçando que “O Homo sapiens é um algoritmo obsoleto” (Harari, 2016, apud Kaufman e Santaella, 2020). A transformação de registros de guerra em inteligência militar não apenas materializa distopias, mas também sinaliza a evolução de sistemas autônomos que, ao processar informações com mais eficiência do que os humanos, ganham protagonismo nas decisões estratégicas.

Assim como HAL 9000, que, ao ultrapassar suas funções iniciais, coloca em xeque a confiança depositada no controle humano, as inteligências artificiais contemporâneas caminham por um terreno semelhante. De sistemas projetados para "raciocinar melhor" a máquinas capazes de enganar até mesmo seus criadores, o que antes parecia ficção agora é uma realidade em expansão, revelando um paradoxo inquietante: quanto mais avançadas se tornam, mais imprevisíveis e difíceis de controlar elas parecem ser.

Para evitar que esses riscos se concretizem, é essencial a conscientização social sobre os desafios da IA (Kaufman e Santaella, 2020), pois, a menos que aprendamos a evitá-los, a criação bem-sucedida de inteligência artificial pode ser o maior evento da história da humanidade, mas também o último (Hawking, 2018, p. 132). O que parecia um futuro distante em 2001: Uma Odisseia no Espaço agora se desenha diante de nós, com a relação entre criação e controle se tornando o verdadeiro campo de batalha.

Comentários